Why rapid on‑chain data prototyping even matters

Rapid on‑chain data prototyping — это фаза, когда вы ещё не строите финальную аналитическую систему, а быстро проверяете гипотезы: какие метрики полезны, какие адреса и события важны, как выглядит поведение пользователей в блокчейне в живую. По сути, это лаборатория поверх цепочки: вы соединяете сырые транзакции, данные смарт‑контрактов и метаданные, чтобы за пару часов понять, стоит ли потом делать полноценный продукт. В отличие от привычной «боевой» аналитики, здесь цель не стабильность, а скорость итераций и низкая цена ошибок — вы можете проигрывать идеи пачками, не раздувая инфраструктуру и не закапываясь в микросервисы и CI/CD.

Базовое правило: вы не оптимизируете сейчас, вы ищете, что вообще имеет смысл оптимизировать. Если вы застряли в настройке кластеров и пайплайнов на неделю, это уже не прототипирование, а преждевременная индустриализация.

Ключевые понятия без воды

Чтобы не путаться терминах, зафиксируем несколько определений. On‑chain data — это всё, что хранится напрямую в блокчейне: транзакции, события (logs), состояние контрактов, заголовки блоков. Off‑chain data — подпорки вокруг него: цены, пользовательские профили, KYC, результаты машинного обучения. Rapid prototyping в нашем контексте — это цикл «подключились к сети → вытащили минимальный набор сигналов → собрали черновой дашборд или сервис» за часы или день. Indexer — это сервис, который читает новые блоки, раскладывает события по схемам и даёт быстрый выборочный доступ, а blockchain data indexing solution — это уже готовый пакетный индексатор плюс хранилище и API, которые вы можете использовать как внешний модуль, не поднимая всё с нуля.

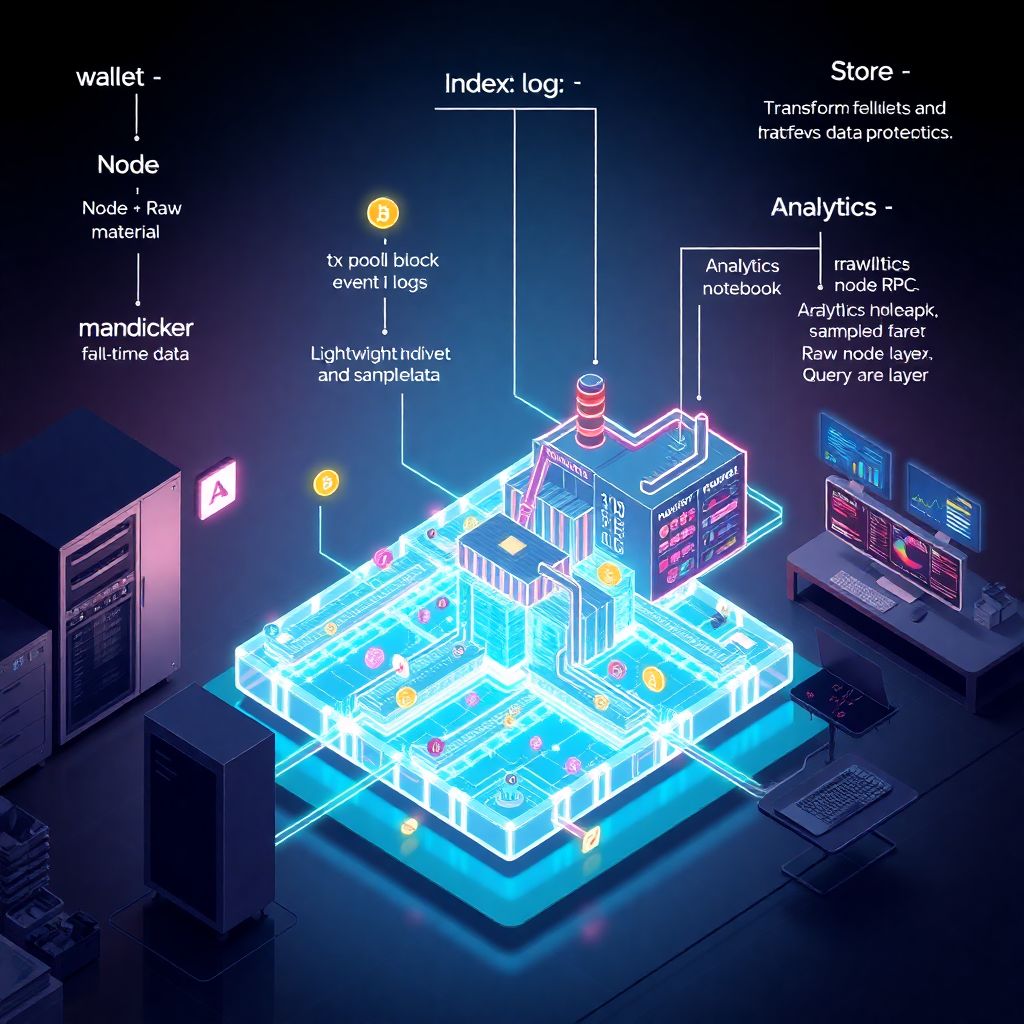

Запомните простую ментальную модель: нода — это сырьё, индексатор — завод, аналитика — магазин, где вы «продаёте» инсайты себе или пользователям.

Диаграммы «в голове» и как ими пользоваться

Многие тратят часы на рисование архитектур в диаграммных редакторах. Для быстрого прототипа полезнее текстовые схемы, которые можно держать прямо рядом с кодом. Пример: [Diagram: wallet → transaction pool → block → event logs → lightweight indexer → analytics notebook]. Этого описания достаточно, чтобы понимать поток данных, не создавая тяжеловесную документацию. Важно уметь описывать уровни: [Diagram: raw node RPC → caching layer → query adapter → notebook / dashboard]. Текстовые диаграммы хорошо ложатся в Git‑репозиторий, легко ревьюятся и не требуют специальных инструментов; вы меняете архитектуру так же быстро, как правите код, что идеально подходит для on‑chain экспериментов с высокой частотой изменений.

Старайтесь, чтобы каждая текстовая диаграмма отвечала на один вопрос: «Откуда приходит сигнал?» или «Куда утекают результаты?». Чем меньше пунктов в такой цепочке, тем быстрее вы сделаете первый прототип и тем проще потом выкинуть неудачную идею.

Когда нода — лишняя, а когда без неё никак

Инстинкт «поднять свою full node» для прототипа часто вреден. Если есть real-time blockchain data API, которое закрывает ваши базовые запросы (логи контракта, баланс, историю транзакций адреса), используйте его без стеснения. На ранней стадии вы не проверяете «как выдержать миллион запросов», вы проверяете, «нужны ли вообще эти запросы». Исключение: если вы тестируете фичи, завязанные на очень свежие блоки, нестандартные JSON‑RPC методы или эксперименты с консенсусом, тогда своя нода оправдана. Но даже в этом случае лучше думать о ней как о временной лабораторной установке, а не фундаменте. Прототипирование выигрывает, когда основные заботы о сети и синхронизации вы перекладываете на внешнюю инфраструктуру, а сами сосредотачиваетесь на бизнес‑гипотезах и UX.

Простой фильтр: если вы можете сформулировать нужные вам данные в виде «адрес+диапазон блоков+фильтр по событиям», вы почти наверняка обойдётесь внешним API быстрее и дешевле, чем собственной нодой.

Инструменты: не строить платформу, а брать готовое

Вместо того чтобы изобретать свою мини‑платформу, разумнее собрать рабочий сетап из готовых строительных блоков, которые уже предоставляют web3 data infrastructure service и похожие решения. Идеальный набор для быстрых экспериментов — это сочетание on-chain data platform for developers, дающей вам запросы по адресам и событиям, и гибкие blockchain data analytics tools на стороне вашего рабочего окружения (например, ноутбуки Jupyter или облачные SQL‑редакторы). Добавьте поверх простой слой кеширования (хотя бы в памяти или через Redis), и вы уже можете гонять одни и те же выборки без избыточной нагрузки на сеть. Главное — не пытаться на первом шаге сделать «красиво и навсегда», а сознательно выбрать временный, но быстрый стек, который вы без сожаления перепишете после доказательства ценности.

Задайте себе вопрос: «Если завтра этот стек исчезнет, насколько больно будет его заменить?». Если ответ — «немного неприятно, но терпимо», вы на правильной траектории прототипирования.

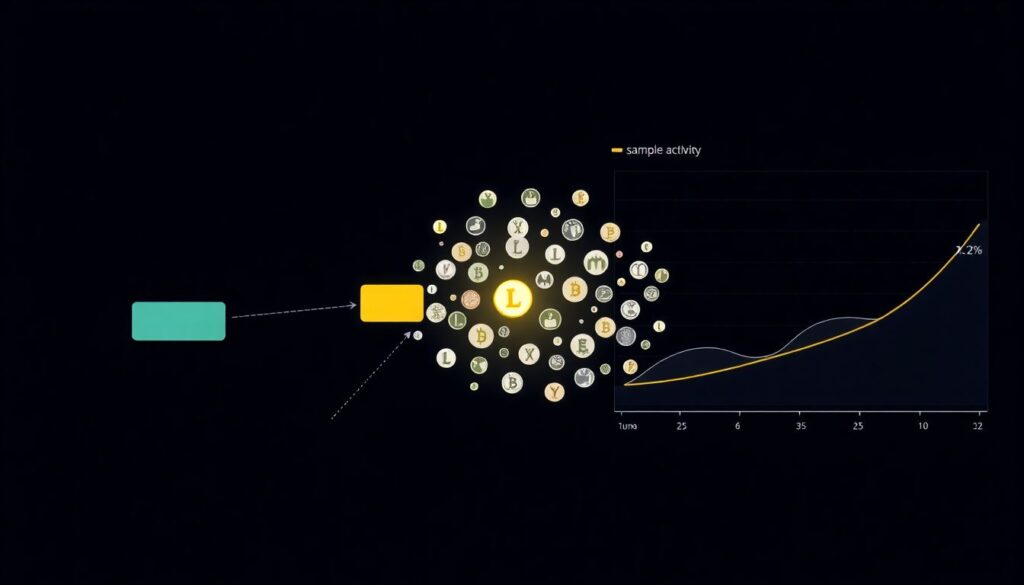

Нестандартные ходы: жёсткий сэмплинг и обратное проектирование схем

Один из самых недооценённых трюков — агрессивный сэмплинг блоков и адресов. Для многих задач достаточно взять, условно, каждый сотый блок и 1–2% активных кошельков, чтобы увидеть форму поведения: пики активности, типы взаимодействий со смарт‑контрактом, динамику комиссий. Лёгкий [Diagram: chain → sampler → minimal index → insight notebook] прекрасно работает там, где люди без надобности прогоняют всю историю сети. Вторая нестандартная идея — не начинать с продуманной схемы БД, а наоборот, сначала «набросать» грубый JSON‑лог того, что вы реально запрашиваете, а затем выводить схему из этих реальных запросов. Такой подход помогает избежать избыточной нормализации данных и делает структуру таблиц производной от реальных аналитических сценариев, а не от теоретических рассуждений.

Если вы на прототипной фазе ощущаете «мы тонем в колонках и JOIN’ах», почти всегда это сигнал, что вы спроектировали схему слишком рано и слишком детально.

Сравнение подходов: DIY против готовых платформ

Самостоятельный подход (DIY) — это когда вы поднимаете ноду, пишете собственный индексатор и API. Он даёт максимальный контроль, но для rapid прототипирования почти всегда избыточен: вы тратите дни на инфраструктуру, а не на проверку гипотез. Альтернатива — использовать готовое blockchain data indexing solution, которое уже прогнало блокчейн через свои пайплайны и предоставляет удобные запросы к событиям и адресам. В контексте быстрых экспериментов важен не только доступ к сырым данным, но и время до первого инсайта. Платформа, где вы можете за час от «ничего нет» дойти до дашборда и простого алерта, выигрывает даже если в цене запроса она чуть дороже. Когда прототип доказывает ценность, вы можете постепенно перетаскивать тяжёлые части в свой более дешёвый и контролируемый стек.

Думайте об этом как о аренде лаборатории: на этапе гипотез выгоднее заплатить за готовое помещение и приборы, чем строить собственное здание.

Лайфхак: прототип как «запросный блокнот», а не микросервис

Ещё один нестандартный совет — первые версии создавать не в виде микросервисов, а в виде запросных «блокнотов»: ноутбук, где в одном файле живут запросы к API, преобразование данных и быстрые визуализации. Такой формат отлично дружит с любой on-chain data platform for developers и значительно понижает порог входа для команды: продуктолог может запустить ячейку, изменить параметр фильтра и сразу увидеть, как меняется результат. Готовый сервис вы успеете написать позже, а вот потратить неделю на его раннюю обвязку и потом понять, что метрика никому не нужна, — типичная ловушка. В прототипном блокноте вы рискуете только парами часов, а не неделями разработки и ревью.

Правило простое: пока вы ещё спорите о том, какие графики вообще полезны, ничего не должно жить дольше одного notebook‑файла и пары вспомогательных скриптов.

Как не застрять в прототипах и перейти к продакшену

Финальный совет: заранее определите триггеры «выхода из песочницы». Например, если дашборд или модель используется командой ежедневно в течение месяца, значит, пора переводить её с временного web3 data infrastructure service и ноутбука на более устойчивый стек и закладывать SLO. Или если число внешних пользователей превысило внутренний порог, перестаньте полагаться только на real-time blockchain data API третьей стороны и подумайте о частичном дублировании критичных данных в своём хранилище. Главное — не вечное «пиление прототипа», а чёткий порог: прототип либо доказывает свою пользу и мигрирует в продакшен‑архитектуру, либо честно выбрасывается. Тогда быстрые эксперименты становятся не хаосом, а управляемым фильтром идей.

Если каждый прототип оставляет после себя хотя бы маленький артефакт — понятное описание данных, диаграмму или кусок кода, — ваша команда накапливает капитал знаний, а не только пачки одноразовых экспериментов.